1週間以上前の5/28ですが、NHK技研公開2011に行ってきました。

今年で3年連続3回目になります。

去年まではまだまだ先の技術が多かったのに対して、今年はすぐそこまで来ている技術が目立った印象を受けました。

気になったところだけ簡単にまとめます。(気になったのは先の技術が多いですが。。。)

■放送と通信の融合

1) ありがちな放送とSNSの融合。デモで行っていたのは不特定多数が対象ではなく、遠隔地の家族など。テレビ電話の発展系のような感じ。

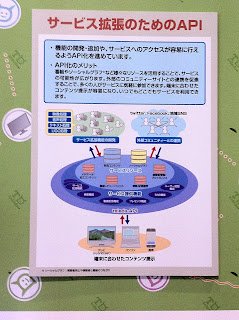

APIを公開予定で、外部のSNSとの連携も可能な様子。

2) 放送が左目映像、通信が右目映像で3D立体視を実現するデモ。説明員に聞いたところ、通信で送っているのも地デジと同じ1440x1080の解像度。輝度情報を放送の方から流用したりといったデータ削減も行っていないとのこと。

■スーパーハイビジョン

シャープの85インチで7680x4320のスーパーハイビジョンディスプレイが展示されていた。おもしろかったのがフルHDの16倍の解像度ということで、HDMIx16で接続されていたところ。HD-SDIの方が取り回しが楽じゃないの!?

初期サンプルということもあって、60Hz駆動だったので最近の240Hzと比べると動きのある箇所は厳しい印象。

ただし、解像感はすばらしい。21.25インチにフルHDが描画されていて、それが視野全体に広がっていることになるわけだから圧倒されるのも頷ける。

写真はスーパーハイビジョンカメラ。

■インテグラル立体テレビ

毎年見ているインテグラル立体テレビですが、今年も進化していました。

7680x4320のスーパーハイビジョン解像度を1レンズ20x20のレンズアレイで撮影して投影を行うのは去年と同じ。(実解像度は384x216)

違いは輝度に影響の大きいGの画素のみ0.5ピクセルずらして2倍にしているところ。立体に見えているところでは去年と違いはほとんどないように感じたが、立体に見える範囲が広がったように思えました。

インテグラル立体テレビで今年新たに行っていたのが、CGでリアルタイムにレンズアレイフォーマットに描画したものを投影するデモ。

ここでも説明員に質問。仮想カメラは、20x20で400視点分かと思ったのですが、実際は40視点分を描画しているそうでした。それも、ガリガリに最適化した上で、分散できるところをGPGPUを使って15fpsほど。ちなみにポリゴン数は7万ほど。

■高ダイナミックレンジプロジェクタ

スーパーハイビジョン映像入力を色成分と輝度成分に分け、色成分は縦横半分の解像度に変換し、色変調を行った後、フル解像度の輝度変調を加えることで110万:1のダイナミックレンジを実現したプロジェクタによる映像。ピーク輝度よりも黒をより黒くに降っていて、しかも黒のコントラストも出ているように感じた。今回のデモでは22.2chのマルチチャンネル音響とも組み合わせてあって没入感はすばらしい。

■撮影情報を利用した映像制作

事前に測定を行ってあるスタジオなどで、カメラからの画像処理のみでカメラ位置、向いている方向、角度などを推定するデモを行っていた。

それにより、違和感なくAR表示を行えるといった趣旨のデモではあったのだが、事前に測定しているのなら、測定データに照明の情報を入れてARオブジェクトに自然なライティングも行って欲しかった。

説明員の話では、画像処理はOpenCVをベースに改良したもので行っているそうでした。

■3次元ミリ波イメージング技術

ミリ波を用いて、カーテンの奥の物体を撮影するデモを行っていた。赤外線で奥行きを取るのをミリ波にすることで布などを通過したデータが取れるということで、撮影した画像も赤外線のデプスセンサーと同じような感じでした。

■超解像技術を利用した画像復元型符号化

映像に100分の1といった極端な圧縮をかけても波状しないで復元できる技術のデモを行っていた。圧縮時のパラメータを復元時に渡し、超解像を行うことで実現しているそうで、波の反射といったやっかいなところも波状していませんでした。

最適なパラメータを求めるために、回数は分かりませんが何度もトライアンドエラーを繰り返しているそうです。(ちなみにCELL REGZAは2回行っているとどこかで見た気がします)

今回のデモの映像は1秒ほどでしたが、作るのに数日かかったらしいのでパラメータの決定までに相当な計算量を行っていると思います。

----

といったところでしょうか。

技術者が説明員をしているのがNHK技研公開のいいところで、つっこんだ質問をすると熱い感じで回答が返ってきます。

この感覚が好きで、また来年も行くことになると思います。